마이크로소프트가 사실적으로 정확하지 않은 콘텐츠 생성을 막기 위한 새로운 도구를 공개함. 이는 일반적으로 환각(hallucinations)으로 알려져 있음.

새로운 수정 기능은 마이크로소프트의 기존 ‘기반 검출(groundedness detection)’을 기반으로 하며, 이는 본질적으로 사용자가 입력한 지원 문서와 AI 텍스트를 교차 참조함. 이 도구는 마이크로소프트의 Azure AI Safety API의 일환으로 제공되며, OpenAI의 GPT-4o 및 메타의 라마와 같은 모든 텍스트 생성 AI 모델과 함께 사용할 수 있음.

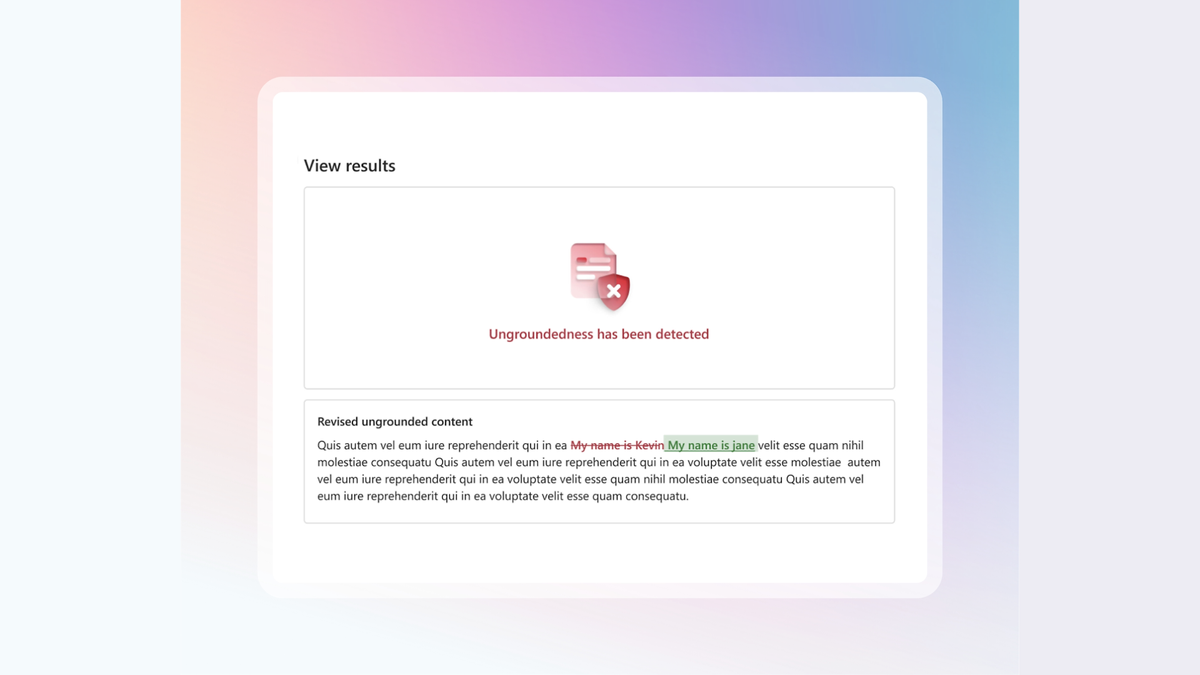

이 서비스는 오류가 있을 수 있는 내용을 표시한 후, 텍스트를 진실의 출처와 비교하여 사실 확인을 수행함. 즉, 사용자는 AI에게 기반 문서 형태로 사실로 간주할 내용을 지시할 수 있음.

전문가들은 현재의 상태가 유용할 수 있지만, 환각의 원인을 해결하지는 못한다고 경고함. AI는 실제로 아무것도 ‘알지’ 못하고, 단지 훈련된 예시를 기반으로 다음에 올 내용을 예측함.

“우리 고객이 비기반 콘텐츠와 환각을 이해하고 조치를 취할 수 있도록 하는 것은 매우 중요함. 특히 AI 생성 콘텐츠의 신뢰성과 정확성에 대한 수요가 계속 증가하고 있기 때문임”이라고 마이크로소프트는 블로그 게시물에서 언급함.

“기존의 기반 검출 기능을 기반으로 하여, 이 혁신적인 기능은 Azure AI 콘텐츠 안전성이 생성 AI 애플리케이션 사용자들이 환각을 경험하기 전에 이를 실시간으로 식별하고 수정할 수 있도록 함.”

현재 미리보기로 제공되는 이 출시는 AI를 더욱 신뢰할 수 있도록 만들기 위한 마이크로소프트의 광범위한 노력의 일환으로 진행됨. 생성 AI는 지금까지 대중의 신뢰를 얻는 데 어려움을 겪었으며, 딥페이크와 잘못된 정보가 그 이미지를 손상시킴. 따라서 서비스의 보안을 강화하기 위한 업데이트된 노력은 환영받을 것임.

업데이트의 일환으로 ‘평가(Evaluations)’라는 사전 위험 평가 도구와 기밀 추론(confidential inference)도 포함됨. 이는 모델이 새로운 데이터를 기반으로 결정을 내리고 예측하는 추론 과정에서 민감한 정보가 안전하고 비공개로 유지되도록 보장함.

마이크로소프트와 다른 기술 대기업들은 AI 기술과 인프라에 막대한 투자를 해왔으며, 최근 300억 달러의 새로운 투자가 발표됨에 따라 계속해서 투자할 예정임.